Почему не виден мой сайт?

Вы можете задаваться вопросом: почему я сделал сайт, а поисковики всё равно не видят его?

Давайте разберемся, что можно сделать.

Начнем с простого: сайт полностью скрыт

Если ваш сайт отсутствует в поиске и вы хотите разобраться, почему так происходит, начните с причин, которые проще всего проверить.

1. Убедитесь, что поисковик знает о сайте

Индексация наступает естественным образом, когда поисковик сам приходит на ваш сайт по ссылкам с других ресурсов.

Зайдите в поисковую систему Яндекс или Google и введите в стройку поиска site:https://promoexpert.pro (вместо нашего сайта введите свой). Если выдача поиска показала страницы вашего сайта, то он проиндексирован.

А можно прямым текстом сказать: «пора индексировать мой сайт!». Это делается для каждого поисковика в отдельности с помощью соответствующего сервиса:

Это очень полезные ресурсы. Вы сможете не только отправить запрос на индексацию сайта, но и следить за этим процессом, получать уведомления об ошибках, а также советы по улучшению технической стороны сайта.

Рекомендуем завести аккаунты и в том, и в другом сервисе.

2. Проверьте файл robots.txt

Файл robots.txt (размещается в корневом каталоге вашего сайта: site.ru/robots.txt) предназначен для того, чтобы давать инструкции роботам-индексаторам из поисковых систем.

С его помощью вы можете скрыть страницы вашего сайта от индексации (например, личный кабинет, корзину покупателя и другие).

Однако если вы видите в robots.txt строки:

— значит роботам запрещено посещать ваш сайт.

Дело в том, что веб-студии запрещают поисковикам заходить на ещё неготовый сайт — чтобы он был скрыт от поиска. Ведь лучше, если люди придут смотреть на готовый проект, чем на стройку. Намерения — благие.

Затем этот файл просто забывается (а иногда — оставляется из обиды и «вредности»). Заказчик не может понять, в чем же он ошибся при продвижении сайта. При этом посещаемость сайта формируется только с «визиток».

Срочно удалите этот файл, если он содержит только эти строки. Затем отправьте запрос на индексацию сайта из пункта 1, чтобы сайт начал отображаться в поисковиках.

3. Сайт может быть под фильтром

Возможно, ваш сайт по каким-то причинам попал под фильтры поисковой системы.

Если на сайт наложен стандартный фильтр (покупные ссылки, плохие тексты), то это легко узнать в разделе «Безопасность и нарушения» в Яндекс Вебмастере.

Если вы видите такую картину как на рисунке ниже, то нужен глубокий анализ. На рисунке мы видим падение трафика с поисковиков примерно в 4 раза. Раз трафик упал с обоих поисковиков — скорее всего, это не фильтр. А что-то не так с сайтом.

Если ничего непонятно — делегируйте анализ нам. Заполните форму ниже для краткого бесплатного аудита. Или читайте далее.

Бесплатный аудит сайта онлайн

Проверяем сайт по 11+ ключевым SEO-параметрам. Результат на почту

От простого к сложному: не все страницы в поиске

Теперь о случаях, которые требуют больше внимания. Что делать, если сайт лишь частично показывается в результатах?

4. Неуникальные тексты

Яндекс может наложить санкции за плохой контент. Источник Яндекс Помощь.

Чужой текст на вашем сайте

За слишком «жадное» заимствования (плагиат) поисковик может наложить санкции и исключить из выдачи.

Для разных типов текстов поисковыми системами допускается разная уникальность:

Если вы заказываете тексты, проверяйте их уникальность. Например, с помощью сервиса text.ru.

Ваш текст на чужом сайте (защищаемся от Яндекса)

Google относительно добросовестно следит за авторством текстов, а Яндекс может поставить сайт плагиатора выше, чем сайт настоящего автора — обидно.

Нужно как-то объяснить Яндексу, что автор — вы.

Есть несколько способов:

5. Страницы-дубликаты

Когда одному и тому же пользовательскому запросу релевантно больше 1 страницы, мы ставим поисковую систему перед выбором: какую страницу показать?

Поисковик разрубает этот «гордиев узел» — он выбрасывает обе страницы из выдачи. Так что с «растеканием релевантности» нужно бороться.

Как можно проверить сайт на наличие страниц-дубликатов?

Система SaitReport определяет дублирование контента на сайте.

После того, как вы их найдете, задайте сайту более четкую структуру. Помните, на запрос пользователя должна отвечать 1 страница (не более).

Мы рассмотрели 5 самых распространенных причин того, почему сайт может пропасть из поисковой выдачи.

Одинаковых сайтов нет. Каждый случай требует индивидуального подхода.

Если вы испытываете затруднения с сайтом, оставьте заявку. Мы свяжемся с вами и подскажем, как решить проблему. Это бесплатно

Whois сервис

Сервис Whois позволяет быстро получить всю информацию о регистрации домена, например, дату регистрации и возраст домена, или узнать контакты, по которым можно связаться с организацией или человеком, чей домен вас заинтересовал.

Для чего нужен Whois сервис

Однако Whois пользуется популярностью не только для проверки домена на занятость, ведь определить, свободен ли домен можно и в процессе подбора имени в доменной зоне. Основная ценность сервиса в том, что он содержит всю информацию о домене, и обычно позволяет получить данные об истории домена и его владельце.

В Whois легко проверить, когда был зарегистрирован домен — узнать дату регистрации домена можно в поле «created». Проверять возраст домена важно не только при покупке доменного имени, информация о сроках регистрации домена полезна при совершении сделок, выборе партнеров и просто анализе информации, размещенной в интернете. Мошенники часто создают сайты-однодневки с выгодными предложениями, и недавно зарегистрированный домен — веский повод усомниться в чистоте намерений авторов сообщения.

Узнать, кому принадлежит домен, через Whois сложнее. Часто персональные данные защищаются на уровне регистраторов или скрываются по правилам реестров. Доверять открытым данным тоже непросто, поскольку администраторы доменов могут указывать ложные сведения при регистрации имени. Но даже если вы не знаете, на чье имя зарегистрирован домен, сервис дает возможность связаться с владельцем доменного имени через форму обратной связи.

Почему Яндекс «не видит» мой сайт?

В понятие «не видит» может быть вложено разное поведение поисковика. В статье разберём, что делать, когда состояние сайта не оправдывает вложенные в него силы и средства.

Есть несколько ситуаций, которые люди описывают как «не видит».

Сайт совсем не индексируется поисковой системой. Проблема актуальна для новых сайтов и старых. Например, вы вносите изменения на страницы, но по прошествии нескольких текстовых апов Яндекса ситуация с позициями не меняется, а текстовая копия страницы в Яндексе остаётся прежней. Здесь нужно в первую очередь смотреть на технические ошибки. Далее в статье рассмотрим, на чём нужно сфокусировать внимание, чтобы исключить влияние технических факторов.

Более сложное решение и более сильные аналитические навыки нужны в ситуации, когда страницы нормально и регулярно индексируются, но позиции не улучшаются.

С таким могут сталкиваться и новые, и старые сайты. Проблема сохраняется, даже если на сайт постоянно вносятся изменения, проводится регулярная работа над контентом, дорабатывается и улучшается функционал, но Яндекс игнорирует ваши старания. Здесь нет точного рецепта, кроме комплексного анализа.

Отсутствует движение в позициях на протяжении нескольких месяцев. Для молодых сайтов это может быть большой проблемой, так как чаще всего только после 3–6-месячного периода активных работ НЧ запросы начнут занимать хотя бы ТОП-50.

Исключаем технические причины

В процессе поиска причин, почему Яндекс не ранжирует ваш сайт, нужно в первую очередь исключить проблему с индексированием.

Как убедиться в наличии/отсутствии страницы/сайта в индексе:

Лучше использовать все методы в комплексе, чтобы убедиться, что страница действительно не в индексе.

Как бороться с проблемой:

Нужно исключить все технические препятствия для нормальной индексации.

Проверьте robots.txt

В файле может быть закрыт весь сайт/раздел/страница.

Примеры запрещающих директив:

Disallow: / # закрыт сайт

Disallow: /products/ # закрыт раздел

Disallow: /diabet_plast.html # закрыта страница

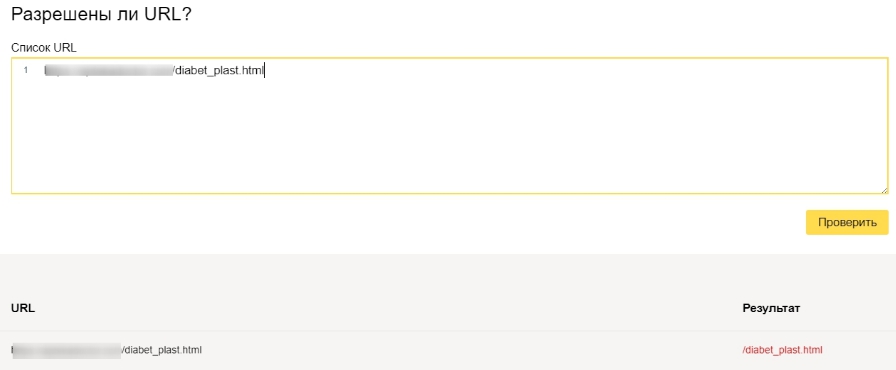

Проверять файл на наличие правил, запрещающих индексирование, лучше через инструмент в Яндекс.Вебмастере «Анализ robots.txt».

На скриншоте ниже показан результат проверки страницы на предмет доступности роботам в файле robots.txt.

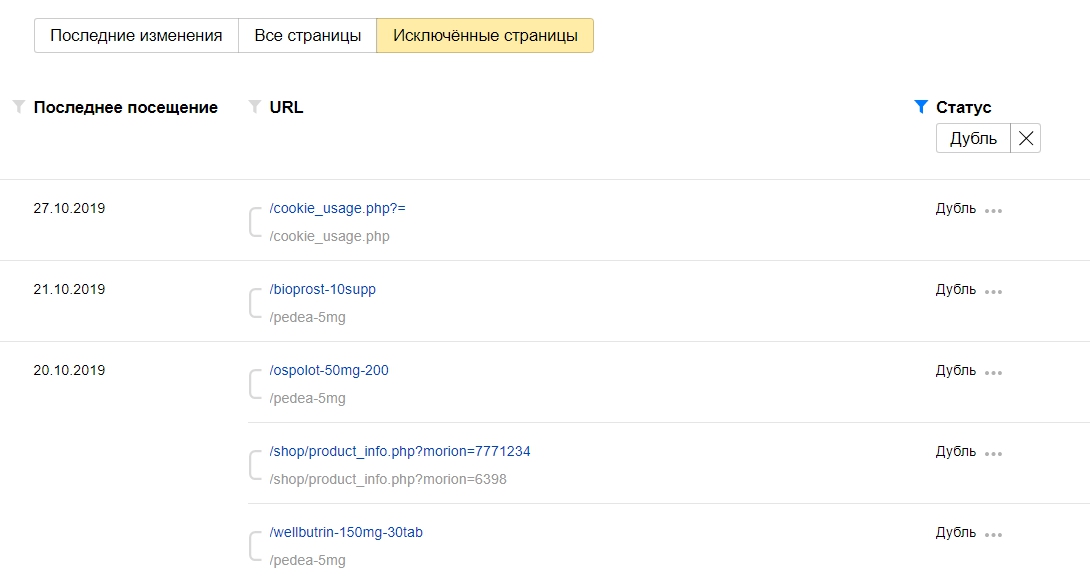

Дубли

Если проблема не с целым сайтом, а всего лишь с одним или несколькими его важными документами, то причина может крыться в наличии дублей. Часто у страницы может просто быть дубль – страница с таким же содержанием, которая либо автоматически создана несовершенствами админки, либо умышленно (но редко встречается).

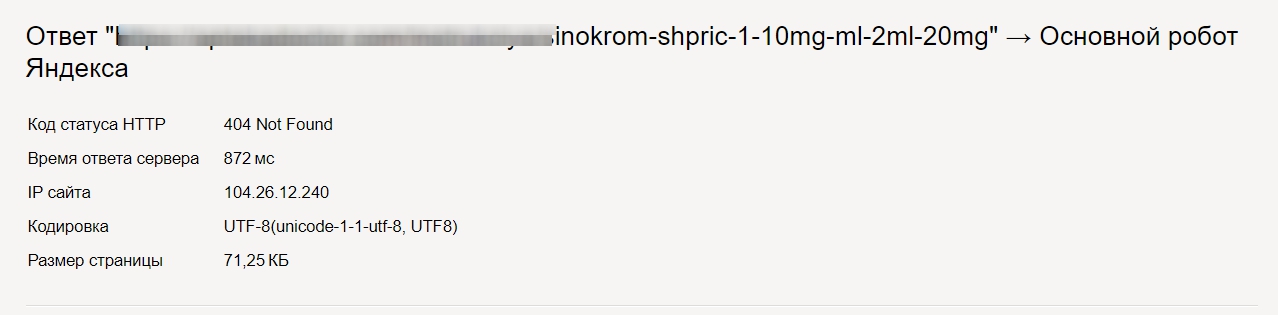

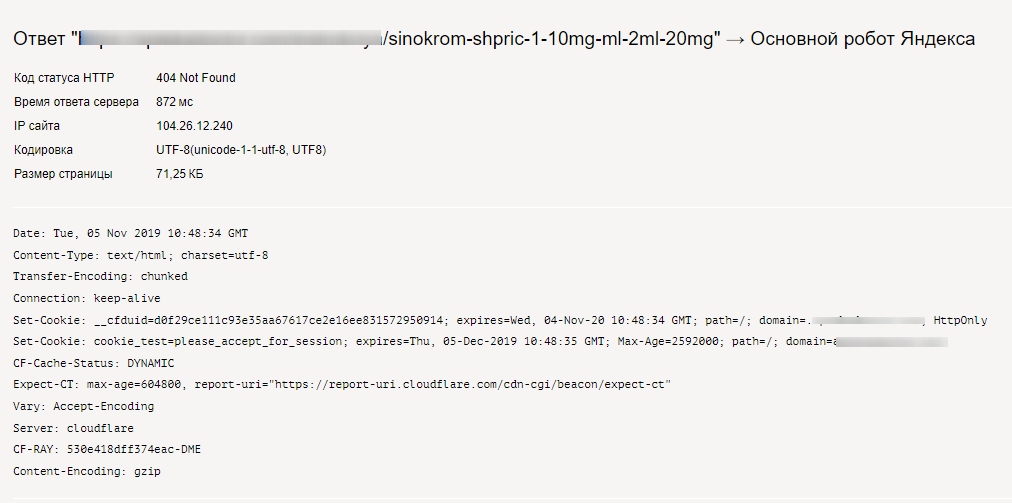

Некорректный ответ сервера

Здесь речь даже не о стандартных случаях, когда у сайта проблемы с доступностью, то есть вы видите реальную 404-тую страницу, вместо главной, или частые уведомления о 5**-тых ошибках. А о том, что визуально сайт работает, но на самом деле сервер отдаёт 404-тый код поисковому роботу. Такие неочевидные ошибки можно выявить через инструмент «Проверка ответа сервера» в панели Яндекс.Вебмастера.

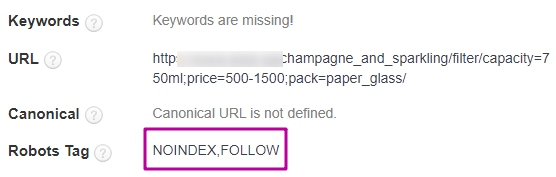

Запрещающие метатеги

Метатеги носят строгий характер для поисковых роботов, поэтому вам стоит тщательно проверить код неиндексируемых страниц на наличие таких конструкций:

Проверять наличие запрета можно через плагин, например, SEO Meta in 1 Click

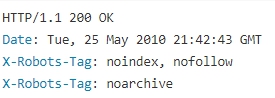

HTTP-заголовоки X-Robots-Tag

В http-ответах сервера могут передаваться запрещающие заголовки.

Существует масса инструментов для проверки ответа сервера и передаваемых в нём заголовков. Один из таких сервисов bertal.ru или тот же «Проверка ответа сервера» в панели для вебмастеров от Яндекса.

Здесь нужно проверять log-файлы сайта и анализировать, какие роботы посещают страницу. Как удобно анализировать log-файлы при помощи Power BI читайте в нашей статье.

Несовершенства внутренней оптимизации

Фильтр

Сайт зафильтрован: чаще всего он в индексе, но не получает ожидаемого трафика. Здесь нужно проверять предупреждения в разделе «Диагностика» – «Безопасность и нарушения».

Если фильтр автоматический, то уведомлений в Вебмастере не будет. Выявить его можно только примерно. Определить, наложен ли фильтр, может помочь наш цикл статей.

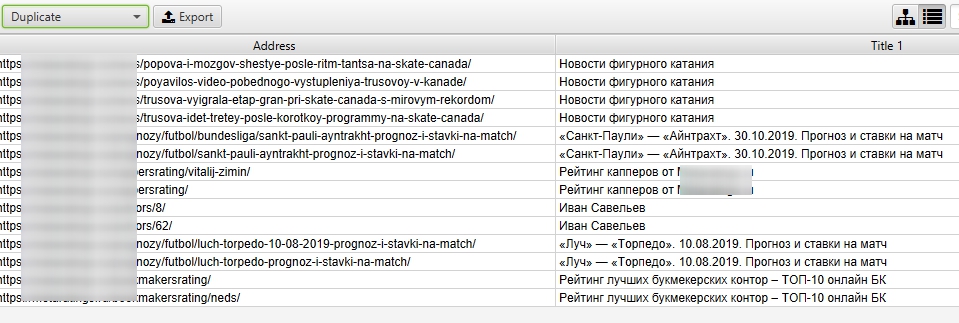

Наличие дублей

Одинаково вероятная причина плохого ранжирования как для новых, так и для старых сайтов. Наличие дублей в целом негативно влияет на оценку сайта поисковиком, путает робота, который вынужден выбирать среди нескольких документов наиболее релевантный.

Проверить наличие технических дублей можно при помощи парсинга.

Выбирайте удобный для себя парсер при помощи нашей обзорной статьи «Обзор ТОП-6 парсеров сайтов».

Увидеть проблему с дублями можно в разделе «Страницы в поиске» – «Исключённые страницы» – фильтр «Дубли».

Неуникальный контент

Проблема с позициями может возникать, если ваш сайт повторяет контент других сайтов. Когда информационный ресурс не содержит добавочной ценности и намерен просто занимать место на серверах поисковиков, то у Яндекса нет оснований предоставлять ему место в ТОПах. Подробнее о ценности уникального контента для поисковых систем в статье.

Недостаточно полная внутренняя оптимизация страницы

Внутренняя оптимизация включает в себя в первую очередь работу с количеством и характером запросов на странице.

Здесь работа должна вестись без отрыва от анализа конкурентов по выдаче.

Как выбрать конкурентов узнайте из нашей статьи – «Как найти новые точки роста поискового трафика».

После вычисления конкурентов проведите сравнительный анализ полноты внутренней оптимизации своего сайта с конкурентами.

Внимание обращайте на такие основные элементы, задающие релевантность документа: Title, H1, анкоры внутренних ссылок, Alt-текст. Сравните, насколько полно оптимизированы ваши страницы, нет ли переспама.

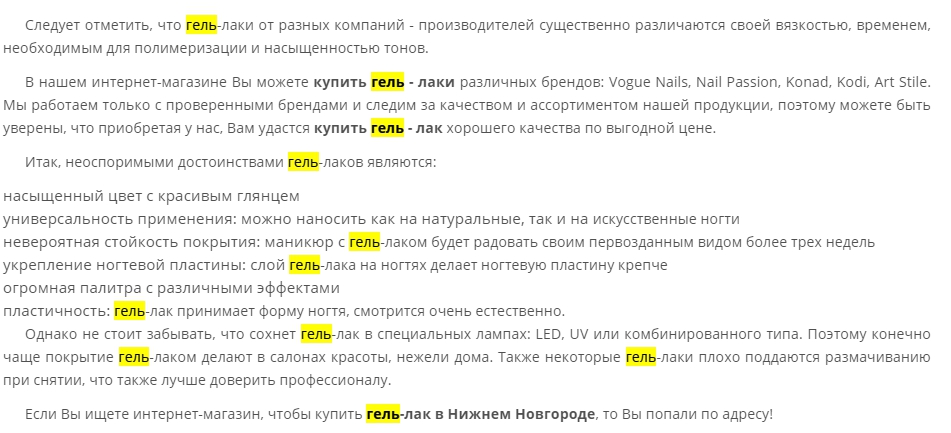

Особое внимание стоит уделить seo-текстам на категориях интернет-магазинов:

Пример спамного текста, который приводит к Бадену:

Помните, что в случае с Яндексом – от seo-текста лучше отказаться. В случае в Google – лучше согласиться на него (если он есть у конкурентов).

Некорректные данные в сохранённой копии

Проблемное ранжирование сайта может быть обусловлено тем, что поисковик не видит какой-то контент, который виден пользователю. Либо, наоборот, может содержать избыточный, дублирующийся контент.

Поэтому проверяйте сохранённую копию страницы, особенно её текстовый вариант.

На примере ниже страница, текст которой открывается через кнопку «Подробнее».

А вот как эта же страница выглядит в текстовой сохранёнке Яндекса.

То есть полный вариант текста показывается роботу дважды.

Новые сайты «не любит» Яндекс

Среди сеошного сообщества последние полгода ходит слух об аналоге «Песочницы» для новых сайтов. Суть в том, что новые сайты не ранжируются Яндексом. Что такое «не ранжируются» – не находятся даже в ТОП-500 тематики со слабой конкуренцией.

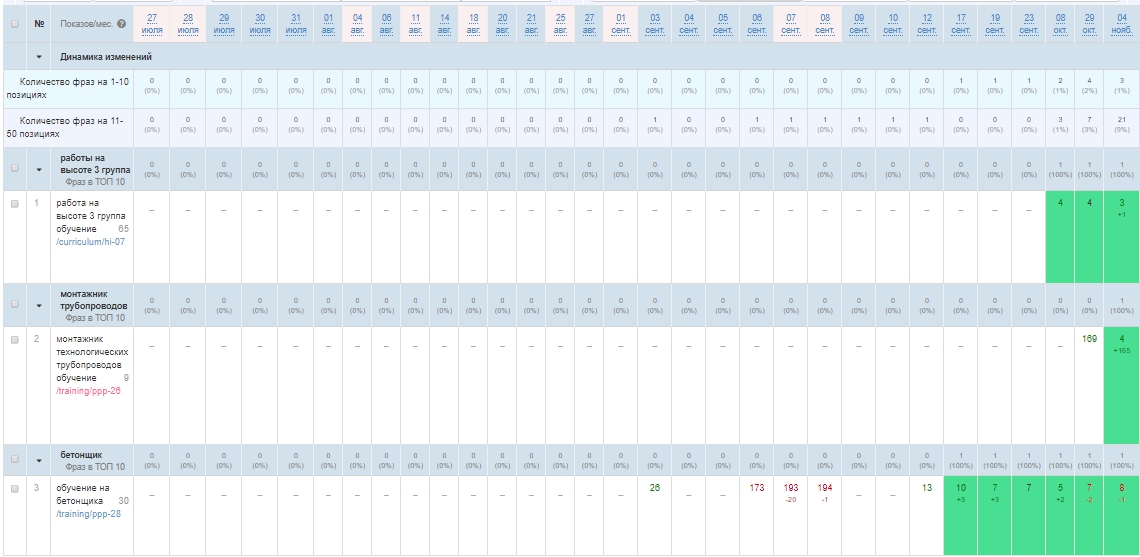

Для примера. Сайт был оптимизирован по технической части, внутренней и велись работы по внешней. Всё это не давало результата на протяжении 3 месяцев. Яндекс упорно не ранжировал сайт более чем по 200 целевым ключам.

Первые результаты появились только в середине сентября при том, что для индексации сайт был открыт ещё в июле.

То есть путь нашего целевого сайта к первым ТОПовым позициям составлял всего лишь три месяца. Но есть случаи, когда Яндекс пускает в первую десятку новые сайты только после шести месяцев. Здесь остаётся только запастись терпением и работать над комплексом факторов – внутренние, внешние, коммерческие и поведенческие. Последние особенно важны, если Яндекс использует свой алгоритм Многорукий бандит для вашего сайта.

Такая история возможна и для информационных ресурсов, и для коммерческих. В нашем примере был сайт услуг.

Выводы

Что делать, если Яндекс упорно игнорирует ваши работы над сайтом? Выжимка рекомендаций для владельцев сайтов:

Если у Вас возникли проблемы с индексацией в Яндексе, обращайтесь к нам!

Почему не виден сайт в поиске?

Начинающие веб-мастера сталкиваются с проблемой: сайт создан и наполнен, а поисковик будто и не заметил новый ресурс. В таких случаях не стоит бить тревогу раньше времени, поисковым системам в любом случае необходимо время, чтобы увидеть сайт, начать его индексацию и внести его в свою базу.

17 причин того, что сайт не отображается

1. Время размещения сайта

Любой поисковой системе необходимо время, чтобы обнаружить новый сайт и запустить индексацию его содержимого. Чтобы помочь поисковикам быстрее заметить Ваш сайт, добавьте его самостоятельно:

2. Медленная индексация

Иногда положение в поисковой выдаче напрямую зависит от скорости индексации страниц, особенно с конкурентным контентом. Поэтому необходимо сразу устранять возможные задержки, которые могут быть вызваны следующими причинами:

Также на скорость индексации влияет наличие внешних ссылок на ресурс. Чтобы поисковые системы скорее нашли Ваш сайт, можно добавить на его новые страницы ссылки из часто обновляемых страниц в социальных сетях. Социальные ресурсы крайне динамичны, поэтому роботы поисковики практически не покидают их.

3. Скрытость от поисковых систем

Иногда веб-мастера забывают об отключенной индексации в структуре кода сайта или в файлах, которые приложены к нему.

Файл robots.txt

Файл robots.txt располагается в корневом каталоге Вашего сайта и необходим, чтобы регулировать работу поисковых роботов. В этом файле Вы можете скрыть от них страницы сайта на время работы с ними, чтобы остановить процесс индексации.

Если в файле robots.txt есть строка:

То содержимое данного раздела (в нашем случае раздела /blog) недоступно для роботов-индексаторов.

Для запуска индексации необходимо удалить из файла данную строку или заменить тег Disallow на обратный ему — Allow:

Блокировка в html-коде

Блокировка ресурса в CMS

Если Вы используете систему управления, в ее настройках есть пункт, который отвечает за скрытие ресурса от поисковых систем. Такая функция нужна для того, чтобы исключить индексацию страниц, пока сайт находится в разработке. Поэтому убедитесь, что Вы отключили этот атрибут перед запуском проекта и индексация началась.

Настройка сервера

То содержимое скрыто от поисковых роботов. Удалив эти строчки, Вы разрешите доступ.

Заголовок X-Robots-Tag

X-Robots-Tag используется в качестве элемента http-ответа для заданного url. У этого заголовка есть те же атрибуты, что и у мета-тега robots, то есть noindex, nofollow.

Если в html-коде прописана строка:

Значит страница не доступна для роботов-индексаторов. Соответственно, чтобы открыть доступ необходимо удалить эту строчку кода.

В большинстве случаев исправление этих ошибок запускает процесс индексации, и сайт появляется в поисковой выдаче.

4. Плохая навигация на страницах

Сайт может плохо ранжироваться и индексироваться в поисковой выдаче по причине сложной структуры и вложенности страниц. Для избежания подобной ситуации рекомендуется сразу создать html карту сайта, чтобы поисковые системы смогли распознать структуру сайта и индексировать его содержимое.

5. Технические неполадки

Технические неполадки чаще всего возникают из-за невнимательности. Решить их легко, но не всегда просто заметить. Ошибки технического характера могут возникнуть из-за неправильной кодировки, неправильных редиректов, наличия ненужных символов в DOCTYPE, ошибки http-заголовка.

6. Блокировка ресурса государственными органами

Размещая на сайте запрещенную информацию, в том числе распространение пиратских материалов, нелицензионного программного обеспечения и контрафакта, будьте готовы к тому, что ресурс могут заблокировать.

Чтобы узнать о блокировке, достаточно перейти на сайт: вместо содержимого будет стоять заглушка со ссылкой на документ.

7. Наличие большого количества рекламы

Наличие блоков с навязчивой рекламой в большом количестве, может спровоцировать рост отказов и снижение среднего времени пребывания на сайте. В дальнейшем из-за ухудшения поведенческих факторов сайт падает в выдаче.

На сайте рекомендуется размещать рекламные объявления от двух компаний — Яндекс Директ и Google Adsense. Скорее всего, поисковые системы не тронут такую рекламу и сайт останется в поисковой выдаче.

8. Фильтр поисковых систем

С помощью фильтров поисковые системы оценивают соответствие сайта их правилам. На основании этой оценки сайты ранжируются в поисковой выдаче. У двух главных поисковых систем — Яндекс и Google, таких фильтров много. Они встроены в алгоритм поисковой системы и дают сигнал, если сайт не соответствует требованиям. После этого принимается решение о наложении санкций: снижение позиции ресурса в выдаче или его блокировка.

Рекомендуется подключать свой сайт к сервисам типа Яндекс.Вебмастера. Они позволят Вам следить за изменениями, которые связаны с посещаемостью, статусом индексирования и другими полезными данными.

9. Низкий процент уникальности материалов на сайте

Если на Вашем сайте расположен материал, который частично или полностью скопирован с других источников, поисковая система считает, что Ваш ресурс не несет пользы для людей. Как следствие, Ваш сайт либо теряет позиции в поисковой выдаче, либо блокируется.

Для разных типов текста поисковыми системами допускается разная уникальность:

Проверить уникальность текста можно с помощью антиплагиата на бирже Text.ru.

10. Наличие множества страниц-клонов

Роботы поисковых систем не очень любят дублирующийся контент. Поэтому, сайты, которые пренебрегают этим и создают копии страниц, чтобы создать видимость наполненности, чаще всего не выходят в ТОП поисковой выдачи.

11. Низкая посещаемость и небольшой объем информации на сайте

Отсутствие на сайте набора ключевых фраз, качественного и достаточного наполнения его контентом, а также плохая реализация проекта в целом провоцирует низкую посещаемость ресурса, из-за которой он не может подняться в поисковой выдаче среди конкурентов. Чтобы исправить эту ситуацию, необходимо проанализировать поисковые запросы пользователей по Вашей тематике. Сделать это можно с помощью сервиса Яндекс Wordstat, который предоставит все запросы пользователей, включающих заданное слово или словосочетание.

12. Большая конкуренция

Когда Вы заполняете сайт, используя только высокочастотные запросы, то скорее всего Вам придется конкурировать за место в ТОПе. Это связано прежде всего с тем, что Ваши конкуренты уже использовали этот ключ ранее. В результате их ресурс выше, если пользователи чаще его посещают.

13. Нет мобильной версии ресурса

Невозможно отрицать, что за последние годы трафик с мобильных устройств увеличился. Исследование компании MediaScope подтверждает это, говоря об использовании мобильного интернета в 61% случаев. Чтобы удовлетворить запросы большей аудитории был создан поисковый алгоритм, который называется Mobile-first indexing. Новые изменения направлены на приоритетную выдачу сайтов, которые оптимизированы под мобильные устройства.

14. Низкая скорость загрузки страниц

От скорости загрузки страницы также зависит позиция сайта в поиске. Логика поисковых систем проста: если пользователи долго ждут загрузку и покидают страницу, так и не дождавшись — ресурс плохой и необходимо понизить его в выдаче.

Оптимальной скоростью принято считать время загрузки не более 3-х секунд.

15. Содержимое не соответствует заявленному

Если на ресурсе располагается материал, который не относится к заголовку страницы — Вероятнее всего сайт даже не попадет в топ, если заголовки нерелевантны содержанию.

16. Переоптимизация

Ваш сайт может упасть в поисковой выдаче из-за высокой плотности вхождения ключевых слов. Такое случается, когда Ваш сайт попадает под алгоритм Яндекса Баден-Баден. Он следит за качеством SEO-текста, если тот плохой, то позиции сайта в поисковой выдаче ухудшаются.

Алгоритмы поисковых систем постоянно совершенствуются, поэтому необходимо проводить тщательную работу с ресурсом, чтобы он оказался в поисковой выдаче:

Почему сайта не видно в поиске

Вне зависимости от того, сколько стоила вам разработка сайта, будь-то пятьсот рублей или два миллиона, стоит заранее ознакомиться с основными причинами возникновения подобных неприятных ситуаций и способах устранения возникающих проблем, негативно сказывающихся на индексации и последующем ранжировании веб-ресурса в поиске.

Основные причины того, что сайт не отображается в поисковой выдаче

Первое, на что хотелось бы обратить внимание, – это время запуска веб-сайта и открытие доступа на него. Устоявшийся среди огромного количества владельцев сайтов стереотип, что интернет-ресурс должен появиться в выдаче «Яндекса» и «Google» сразу же после его размещения на хостинге или выделенном сервере. На самом деле, ситуация складывается другим образом, а именно:

при создании нового веб-сайта и его размещении на новом домене потребуется в среднем от 1 до 3 недель для того, чтобы он был обнаружен поисковыми роботами «Yandex» и «Google» и начался процесс его индексации, позволяющей производить ранжирование в органической выдаче;

при размещении нового сайта на старом домене может произойти замедление процесса индексации, связанное с присутствием негативного возможного «наследства» восприятия ресурса поисковыми системами.

Оба варианта характерны при запуске нового интернет-ресурса. В некоторых ситуациях возможно и увеличение временных затрат на индексацию из-за технических нюансов и/или особенностейпостроения данного сайта. К примеру, если ресурс имеет сложную иерархию и структуру, многоуровневую навигацию, динамический (генерируемый из базы данных) контент, может потребоваться и более месяца на то, чтобы он стал доступен в естественной выдаче.

Чтобы узнать о том, состоялась ли индексация интернет-ресурса, стоит воспользоваться специальными инструментами «Яндекс Вебмастер» и «Google Search Console». В ситуации, когда интернет-сайт не отображается в поиске дольше указанного срока, стоит рассмотреть вероятность возникновения различных проблем, которые могут быть следующими:

Невидимость для поисковых машин – довольно частое явление и характеризуется тем, что ресурс частично или полностью скрыт от поисковиков. Это может быть связано с отключением индексации в файле «robots.txt» или наличиямета-тега «NOINDEX» на какой-либо странице.

Блокировка интернет-ресурса в файле «.htaccess» может послужить ещё одной причиной, из-за которой поисковые роботы часто не замечают сайт. В случае использования систем администрирования (CMS), в панели управления есть специальный пункт в настройках, скрывающий веб-ресурс от роботов поисковых систем. Даная опция позволяет исключить нежелательную индексацию источника ещё в процессе разработки ресурса. Многие разработчики в спешке после окончания работ забывают отключить атрибут, что и является причиной отсутствия сайта в естественной выдаче.

Технические неполадки, связанные с затруднением или полной невозможностью произведения процесс индексирования роботами поисковых систем. Как правило, возникают при использовании самодельных систем управления, которые любят навязывать некоторые разработчики с целью дальнейшей привязке к себе на постоянное обслуживание. Программисты не любят работать с незнакомым «чужим» кодом и потому, стоимость обслуживания веб-ресурса на самодельной CMS будет значительно дороже популярных и широко распространенных. Этим и пользуются любители «самопальных» систем, практически не оставляя альтернативного варианты.

Проблемы с навигацией на сайте. Ещё одна разновидность, оказывающая негативное влияние на индексацию и ранжирование веб-ресурсов в органической выдаче. В большинстве случаев, возникает из-за использования динамически создаваемого контента, сложной иерархии и вложенности страниц. Чтобы исключить влияние негативного фактора, рекомендуется создать карту сайта, регулярно её обновлять и пополнять, что позволит поисковым роботам «ближе» познакомиться со структурой и содержимым ресурса.

Попадание под фильтр поисковых систем. Если вы до сих пор используете закупку внешних ссылок в качестве способа продвижения веб-сайта или занимаетесь искусственной накруткой поведенческого фактора, высока вероятность попадания под действие фильтра со стороны поисковых роботов «Яндекса» и «Google», что грозит резкими изменениями в ранжировании, вплоть до полного исключения из выдачи и занесения в черный список.

Сайт виден и доступен, но находится слишком далеко в поисковой выдаче. Довольно распространенная ситуация, при которой веб-ресурс виден в поисковике, но его позиции выходят далеко заТОП-50, 100, 200, 300. Процесс происходит при влиянии следующих негативных факторов:

низкая уникальность содержимого на сайте, наличие плагиата и «чужого» текста;

дублирование информации, присутствие страниц-дубликатов;

кто-то использует ваш контент, заявляя о его уникальности в панелях веб-мастеров;

ошибки разметки и оформления;

шаблонность при оформлении заголовков и разделов;

малый объем текста на ресурсе (менее 500 знаков без пробелов) и низкая посещаемость;

навигация построена на flash и ajax;

высокий уровень конкурентности (в поиске имеется более 30 «крутых» сайтов, которые плотно обосновались при ранжировании ресурсов в органической выдаче);

наличие на вашем интернет-ресурсе «черных» ссылок, ведущих на веб-сайты, попавшие под санкции «Яндекса» и «Google»;

размещение «битых» ссылок и пустых файлов;

перенасыщенность внутренними и внешними ссылками (одна страница веб-ресурса должно содержать не более 100 веб-ссылок);

отсутствие мобильной версии (адаптивности), ведущее к «просадке» трафика, идущего со смартфонов и планшетов;

долгая скорость загрузки страниц;

несоответствие содержимого, интересам посетителем, «не раскрытие» темы до конца (в случае с информационными источниками);

наличие вредоносного кода, вируса, скрытых ссылок, осуществляющих перенаправление;

сервер (хостинг), на котором размещается интернет-ресурс, не справляется с нагрузкой.

Могут встречаться и другие причины низких поисковых позиций веб-сайта, выявить точную проблему лучше всего обратившись к специализированному профильному специалисту по поисковому продвижению.

Итак, разобравшись с основными причинами отсутствия сайта в естественной выдачи поисковых систем, рассмотрим способы диагностирования (выявления проблем), а также варианты исправления сложившейся ситуации.

Инструменты для выявления причин, из-за которых сайт не видно в поиске.

Двумя основными инструментами являются: «Яндекс Вебмастер» и «Google Search Console», позволяющие не только своевременно обнаружить возникающие с веб-ресурсом проблемы, но и ознакомиться с прохождением самого процесса индексации более наглядно.

Чтобы использовать представленные сервисы, достаточно иметь аккаунты в «Yandex» и «Google» и пройти процесс подтверждения прав на веб-ресурс. Практически сразу же после этого, отобразятся возможные проблемы с сайтом.

Здесь же можно произвести и дополнительное диагностирование интернет-сайта. Доступны инструменты проверки прохождения процесса индексирования, файлов robots.txt и sitemap.xml, а также удобство просмотров на мобильных устройствах.

Практически обо всех проблемах, связанных с индексацией информации на сайте и его видимости для поисковых машин, можно узнать, используя всего лишь данные инструменты.

Дополнительно следует упомянуть о таком сервисе, как «Page Speed Insights», который позволяет измерить скорость загрузки страниц веб-ресурса при заходе с ПК или мобильного телефона.

Практически сразу же после окончания анализа, отобразятся рекомендации, следуя которым можно улучшить быстродействие интернет-ресурса для различных типов устройств. Данный инструмент может помочь улучшить позиции в органике.

Если вы хотите произвести быструю оценку индексирования сайта в поисковиках без использования панелей веб-мастера,можно использовать специальный онлайн-сервис, доступный по ссылке: http://www.raskruty.ru/tools/index/

Инструмент бесплатный, для использования достаточно всего лишь ввести url интересующей страницы.

После нажатия кнопки «Проверить индексирование», отобразится таблица с информацией о том, сколько страниц проиндексировано в поисковых системах «Яндекс» и «Google».

Следующим шагом после обнаружения причин, из-за которых сайт не отображается в результатах поисковой выдачи, будет их непосредственное устранение.

Как исправить возможные причины отсутствия сайта в поиске

Для удобства восприятия информации, систематизируем данные в виде таблицы.

Сайт недавно создан или комплексно обновлен/видоизменен и ещё не успел проиндексироваться поисковыми роботами

Ждать от 2 до 4 недель до прохождения полной индексации. В случае, если по истечении данного периода времени процесс не был произведен, смотреть на другие проблемы.

«Яндекс Вебмастер» и «Google Search Console»

Невидимость для поисковых машин

«Яндекс Вебмастер», «Google Search Console», «просмотрщик» кода в любом веб-браузере (F12)

Если вы не обладаете навыками веб-программирования, поисковой оптимизации сайта, рекомендуется обратиться к профильным специалистами, так как попыткаразобраться и устранить неполадки самостоятельноможет привести к неблагоприятным последствиям, вплоть до полной потери веб-сайта

Попадание под фильтр поисковых систем

Выяснить под какой именно фильтр вы попали, и что именно являлось причиной попадания под него.

Провести работу по нормализации своего веб-ресурса (устранить переоптимизацию, повысить качество сайта в целом, убрать шаблонность в заголовках и сниппетах, отказаться от агрессивной рекламы, отказ от закупки ссылочной массы и накрутки поведенческого фактора и др.) и его возвращению на прежние позиции. После окончания манипуляций, потребуется определенное время, чтобы поисковики отменили санкции по отношению к интернет-ресурсу

«Яндекс Вебмастер», «Google Search Console»

Блокировка веб-ресурса государственными органами из-за наличия на нём какой-либо запрещенной информации, содержимого пиратского, террористического или другого характера

Выяснить точную причину блокировки, устранить проблему и согласовать данный факт с органом, по решению которого и было вынесено решение заблокировать ваш веб-сайт. В случае «вечной блокировки»- отказаться от противозаконной деятельности, так как есть риск столкнуться и с более серьезными последствиями, такими как уголовная ответственность согласно действующему законодательству

«Яндекс Вебмастер», «Google Search Console»

Сайт виден и доступен, но находится слишком далеко в поисковой выдаче

Комплексная работа над поисковой оптимизацией сайта и его продвижению в органике. После анализа его текущего положения, произвести переработку контента, удалению дублей, грамотному структурированию содержимого, устранению технических неполадок и т.д. При возникновении затруднений, рекомендуется обратиться к профильному специалисту или в веб-агентство.

«Яндекс Вебмастер», «Google Search Console», «Page Speed Insights», инструменты для сбора позиций (ознакомиться можно по ссылке)