Сравниваем DDR3 и GDDR5 | Важные отличия

Видеокарты в компьютерах постоянно эволюционируют, и их эволюция идёт семимильными шагами. Казалось бы, ещё лет 10-15 назад даже 128 мегабайт видеопамяти и 560 мегагерц тактовой частоты видеопроцессора было топовым, недостижимым для большинства «простых смертных» решением. А сейчас – вон RTX, 1.6 ГГц видеопроцессор, 4352 ядра CUDA, 12 ГБ памяти…

Впрочем, кое-что роднит «новые» топовые видеокарты со «старыми» – они так же недоступны для «простых смертных». Поэтому людям, которые хотят приобрести игровой компьютер, но при этом не желают продавать почку и машину, приходится выбирать какое-либо компромиссное решение. И отыскать подходящую модель не так просто, как хотелось бы.

Ведь на среднем и нижнем ценовых сегментах начинается битва технических характеристик. На пользователя вываливают кучу информации – о ядрах, о частоте, о дисплеях, о видеопамяти… На что обращать внимание, а что проигнорировать?

Одна из важнейших характеристик, определяющих быстродействие видеокарты – это тип видеопамяти. И в это материале мы разберём, в чём разница между DDR3 и GDDR5, а также определимся, какой графический ускоритель всё-таки выбрать.

Видеопамять стандарта DDR3

Видеопамять стандарта DDR3 (также называемая GDDR3, Graphics DDR3) – устаревший по состоянию на настоящий момент вариант. Графические ускорители, оснащаемые ею, выпускались с 2004 года по 2015-2016 годы. Затем она потеряла единственное своё преимущество в сравнении со следующим поколением– цену. GDDR5-видеокарты стали дешевле.

В целом видеопамять DDR3 характеризуется следующим образом:

Максимальная тактовая частота – 2,5 ГГц;

Энергопотребление – 2 В;

2 передаваемых бита за такт.

Таким образом, памятью DDR3 оснащаются только малопроизодительные видеокарты. Конечно, в 2010 году они были верхом мощи и совершенства, но за окном немного не эта дата. На компьютере, оснащённом DDR3-видеокартой, в современные игры «побегать» не удастся.

Единственный плюс DDR3 – это сравнительно низкая цена. Купить конфигурацию с 4 ГБ видеопамяти в 2019 году за 6 тысяч рублей – более чем реально. За устройство с таким же объёмом и подобным графическим ускорителем, но на DDR5, придётся заплатить в лучшем случае вдвое больше.

Итак, подведём итоги.

Достоинства

Недостатки

Сравнительно низкая производительность;

Кроме того, памятью стандарта DDR3 оснащаются и так называемые профессиональные видеокарты. Эти графические ускорители используются в первую очередь для создания 3D-моделей, расчёта искусственного интеллекта и проведения многопоточных математических вычислений. И они также дешевле GDDR5-моделей, так что DDR3-конфигурации можно использовать в бюджетных организациях и домашних серверах, на которых «крутится» искусственный интеллект или что-то в этом духе.

Видеопамять стандарта GDDR5

Видеопамять стандарта GDDR5 – это новое и актуальное на момент составления данного материала (июнь 2019 года) поколение носителей. Именно она устанавливается в абсолютное большинство графических ускорителей – от бюджетных до топовых, от мобильных до настольных. Она разработана с нуля специально для использования в видеокартах, благодаря чему достигается высокая производительность.

Компания AMD выпускает свои видеокарты на GDDR5 с 2008 года. NVIDIA немного задержались – релиз первого устройства на этой памяти состоялся в 2010 году.

В целом GDDR5 характеризуется следующим образом:

Максимальная тактовая частота – 7 ГГц (но на практике она практически не встречается, в отличие от 4-5 ГГц);

Энергопотребление – 1.5 В;

4 передаваемых бита за такт.

Всё это делает GDDR5-стандарт очень производительной видеопамятью. О скорости её работы говорит также то, что в некоторых игровых консолях (в частности PS4) и серверных конфигурациях, где требуется максимальное быстродействие в сочетании с отказоустойивостью, GDDR5-модулю используются в качестве «оперативки».

Итак, подведём итоги.

Достоинства

Высокая производительность, которая отвечает требованиям современных игр;

Недостатки

Видеокарты с видеопамятью GDDR5 – это современное решение, которое отвечает актуальным требованиям по производительности. Увеличенная вдвое по сравнению с DDR3 скорость работы обеспечивает быстрый доступ к любым шейдерам, библиотекам и объектам, хранящимся в накопителях GDDR5.

GDDR5 в 2019 году оснащаются графические ускорители всех классов – и бюджетного, и среднего, и топового. Вопрос лишь в объёме и производительности ядра. Кроме того, стоит учесть, что конкретная скорость зависит от модели видеокарты, её производителя и некоторых других параметров.

Сравнение

Итак, DRR3 дешевле, а GDDR5 – производительнее. Но этим разница между ними не ограничивается.

Сравним два стандарта:

Минимальная цена видеокарты (на момент написания статьи, по данным интернет-магазина «ДНС»)

Предельная тактовая частота, ограниченная сверху технологией

В целом, «бюджетность» DDR3 совершенно не оправдывает экономии. Сейчас лучше брать варианты на GDDR5.

NVIDIA водит нас за нос! Сравнение видеокарт GT 1030 с памятью GDDR5 и DDR4

На рынке сегодня можно встретить две видеокарты с одинаковым названием и по схожей цене, но с абсолютно разной производительностью. Речь идет о GeForce GT 1030 от NVIDIA. Одна часть видеокарт оборудована актуальной GDDR5-памятью, другая — памятью DDR4, которая по своим характеристикам и производительности является старьем из прошлого. Об удивительной политике NVIDIA, вводящей в заблуждение, мы и рассказываем сегодня.

Весной 2017 года без особой помпы на виртуальных прилавках появилась видеокарта GeForce GT 1030 с памятью GDDR5 из ультрабюджетного сегмента. Она находится примерно на заднем крае прогресса и предназначена для самых дешевых сборок, где и игры-то особо не рассчитывают запускать. Хотя для нетребовательного гейминга при разрешении Full HD эта видеокарта подходит.

Весной 2018 года тише и скромнее вышла еще одна видеокарта GeForce GT 1030. Слегка модифицированная. Она комплектуется другим типом памяти (DDR4), который позволил незначительно, но удешевить видеокарту.

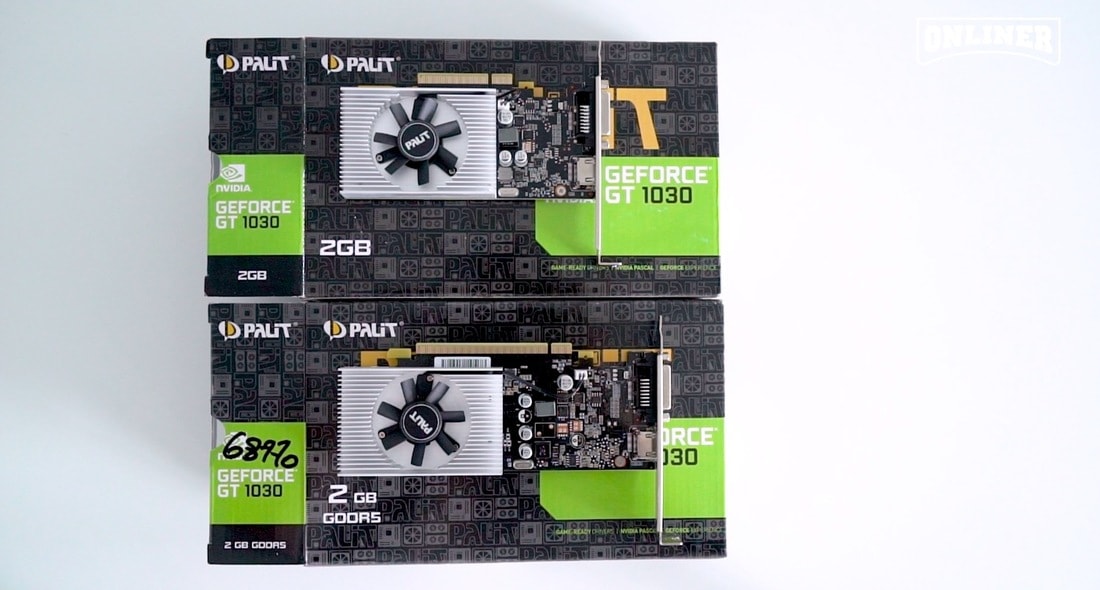

Эту разницу мы и продемонстрируем на конкретных видеокартах в некоторых играх, а также воспользуемся поводом разъяснить, как пропускная способность памяти влияет на производительность. Отметим, что в статье фигурируют видеокарты от Palit. Но аналогичная ситуация характерна и для других контрактных производителей, которые работают с NVIDIA (MSI, ASUS и другие), так как они находятся в жесткой зависимости от спецификаций производителя.

Но прежде чем приступить к конкретному разбору, отметим, что изменять в продукте некоторые нюансы — это не преступление. Криминалом попахивает лишь тогда, когда производитель старается целенаправленно запутать покупателя, выпуская две разные видеокарты под одним наименованием. Намного честнее по отношению к пользователям было бы дать видеокарте 2018 года имя GT 1020 или GT 1030 SuperShit Edition. Но NVIDIA почему-то решила подмочить свою репутацию на такой ультрабюджетной мелочи.

Видеоускоритель GT 1030 vs «видеозамедлитель» GT 1030

Для начала представим наших подопытных. Это две видеокарты GT 1030 в исполнении компании Palit. Их нам во временное пользование предоставил интернет-магазин Socket.by, за что мы безмерно ребятам благодарны.

У образца 2017 года частота графического процессора равна 1227 МГц (1468 МГц в режиме Turbo), тогда как у более новой модели — 1151 МГц (1379 МГц). Разница по частотам заметная, но отнюдь не она играет ключевую роль в разбежке по производительности.

Та видеокарта, что вышла в 2017 году, — длиннее, оборудована 2 ГБ памяти GDDR5, которая обладает пропускной способностью в 48 ГБ/с. Вариант 2018 года чуть короче и имеет 2 ГБ памяти DDR4 с пропускной способностью в 16,8 ГБ/с. В обоих случаях ширина шины памяти идентичная — 64 бита, но вот частота работы памяти в живых примерах кардинально разнится: у DDR4 она составляет 1050 МГц, у GDDR5 — 3000 МГц.

По итогу дряхлая пропускная способность DDR4 на видеокарте GT 1030 сравнима с устаревшей скоростью видеопамяти, которая применялась на устройствах 4—6-летней давности.

Практика тестов

Нагляднее всего разница между двумя типами памяти в графических приложениях видна в играх. Мы вставили видеокарту GT 1030 GDDR5 в компьютер с Intel Core i-5 4690 и 8 ГБ оперативной памяти и прогнали ее на нескольких играх в разрешении Full HD. Затем то же самое и на тех же настройках графики сделали с видеокартой GT 1030 DDR4.

Специальный бенчмарк World of Tanks Encore на средних настройках графики в первом случае выдал нам в среднем 82 кадра в секунду, во втором — 37 кадров в секунду. Разница более чем в два раза.

В игре «Ведьмак 3» на самых низких настройках графики видеокарта с GDDR5 демонстрирует в среднем 34 кадра в секунду (в Новиграде), видеокарта с DDR4 — в среднем 17 кадров в секунду. И если в первом случае кое-как с микрофризами играть еще можно, то во втором придется понижать разрешение картинки.

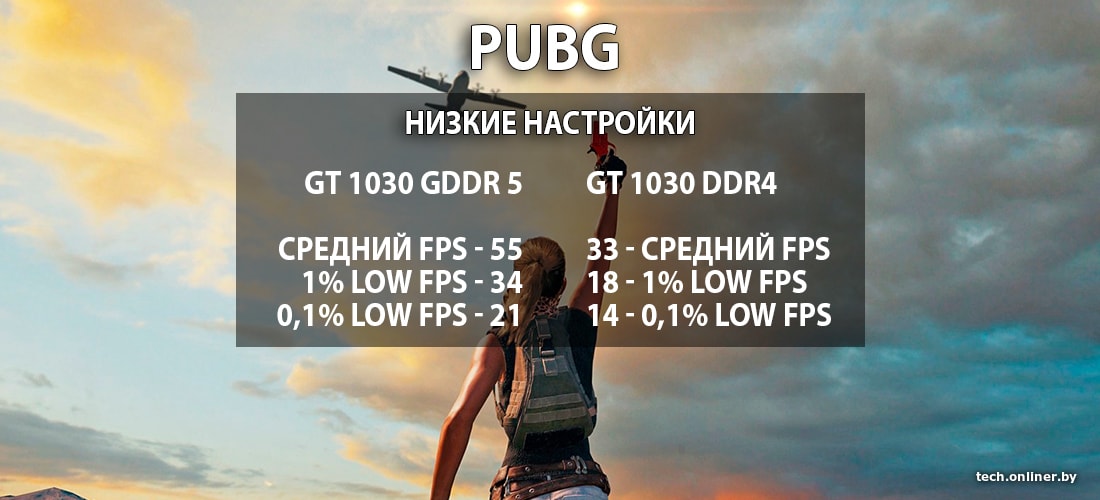

В PUBG на низких настройках средний FPS в первом случае составил 55 кадров в секунду, во втором — 33 кадра в секунду. При этом просадки были куда более заметными и некомфортными.

Игра Rocket League на средних настройках оказалась не по зубам видеокарте с памятью DDR4 — средний FPS составил 23 кадра в секунду, тогда как GT 1030 с GDDR5 продемонстрировала 51 кадр в секунду.

Проект Dark Souls 3 на минимальных настройках оказался неиграбельным на видеокарте GT 1030 DDR4 — всего 17 кадров в секунду. Пациент же с памятью GDDR5 продемонстрировал 37 кадров в секунду.

Лучший инди-платформер прошлого года Hollow Knight в случае с памятью GDDR5 шел со средним FPS, равным 136, тогда как на более новой видеокарте можно рассчитывать на 67 кадров в секунду.

Игра Overwatch прекрасно оптимизирована и на «затычке» с GDDR5-памятью демонстрирует 87 кадров в секунду при низких настройках. А вот «затычка» с DDR4-памятью из прошлого смогла показать лишь 36 кадров в секунду.

Немного о пропускной способности памяти

Видеокарты находятся в экстремальной зависимости от скорости памяти. Не припоминается случая, чтобы на рынке видеокарту, сперва выходившую с актуальной памятью GDDR5, со временем подменили на «обрубок» с памятью DDR4. Хотя за всю историю индустрии бывали случаи, когда производители устанавливали на видеокарты память большего объема, но более старого типа, с низкой пропускной способностью. И тем самым вводили в заблуждение потребителей. Так уж устроены геймеры, что почему-то в первую очередь смотрят именно на объем памяти, а не на ее частоту или ширину шины. Хотя это — одни из самых важных параметров, которые влияют на производительность.

На заре компьютерной индустрии производители видеокарт особо не выбирали, какую память им использовать для своих устройств: скорость традиционной оперативной памяти их вполне устраивала. Но со временем росли разрешения мониторов, усложнялась графика и улучшались текстуры. Скоростей ОЗУ для подпитки видеокарт данными для обработки уже было недостаточно. От DDR2-памяти со временем отпочковалась GDDR3 (Graphics Double Data Rate). Впервые в коммерческом продукте ее использовали в видеокарте от NVIDIA в 2004 году. Технологической базой для данного типа памяти стала оперативная память DDR2, но с уменьшенными требованиями по питанию, рассеиванию тепла и соответствующая требованиям работы с графикой. Этот тип памяти применялся в видеокартах как для компьютеров, так и для консолей актуального поколения (PS3, Xbox 360, Wii).

Частоты видеопамяти росли, появилась GDDR4 (не получила широкого распространения), а затем в 2008 году — и GDDR5. С тех пор особых прорывов не было. Например, нынешняя GTX 1070 с этим типом памяти при шине в 256 бит демонстрирует пропускную способность в 256 ГБ/с. Лишь в 2016 году для топовых решений NVIDIA (GeForce GTX 1080) были задействованы чипы памяти GDDR5X, которые вдвое превзошли предшественника по пропускной способности. Таким образом, флагманы GeForce GTX 1080 Ti и GTX 1080 демонстрируют скорость памяти на уровне 484 ГБ/с (шина — 352 бита) и 320 ГБ/с (шина — 256 бит) соответственно.

Ширина шины памяти в данном случае — это ширина канала, который соединяет память и графический процессор. Битностью характеризуется возможность этого мостика подавать процессору как можно больше данных за единицу времени. Чем больше шина, тем производительнее и дороже будет видеокарта.

DDR4, в свою очередь, отлично чувствует себя как оперативная память, но ее пропускная способность в качестве графической памяти оставляет желать лучшего. Это практически технологии давно ушедших дней, сравнимые по производительности с памятью DDR3 в бюджетных видеокартах GeForce 600-й или 700-й серии.

Благодарим за предоставленные комплектующие интернет-магазин Socket.by

Читайте также:

Наш канал в Telegram. Присоединяйтесь!

Быстрая связь с редакцией: читайте паблик-чат Onliner и пишите нам в Viber!

7 распространенных ошибок при выборе видеокарты

Содержание

Содержание

Естественное желание каждого покупателя — получить максимум отдачи от приобретенного товара. То есть — выбрать из конкурирующих решений наиболее качественное, функциональное, либо просто в большей степени соответствующее вкусам нового владельца.

Это стремление логично и не нуждается в каких-либо пояснениях. Но парадокс заключается в том, что чем более технологичным (а следовательно — более дорогостоящим и менее регулярно приобретаемым) является товар — тем в меньшей степени покупатели склонны оценивать его первостепенные характеристики, обращая внимание на менее значимые моменты или вовсе сводя покупку в область эмоций.

Комплектующие для компьютера — в частности, видеокарты, — отнюдь не исключение из этого правила. Ошибок при их выборе совершается немало, и в данной статье мы постараемся осветить основные из них.

Нужно ли смотреть на объем памяти?

К сожалению, фразы вроде «фу, у этой карты 4 гигабайта, на ней только в пасьянс играть!», «у этой видеокарты всего 6 гигабайт памяти, я лучше возьму вот эту — у ней сразу 8!» или бессмертное «у меня карта на 8 гигабайт, эта игрушка на ультра летает!» буквально заполоняют компьютерные форумы, карточки товаров в интернет-магазинах, социальные сети и прочие смежные ресурсы.

Принято считать, что чем больше у карты набортной памяти — тем выше ее производительность, а прочие характеристики либо второстепенны, либо вовсе не имеют значения.

На самом деле, конечно же, это не так.

Набортная память видеокарты сама по себе не влияет на производительность — это всего лишь хранилище для используемых видеокартой данных. И фраза о преимуществах видеокарты с 8 гигабайтами набортной памяти над картой с 6 гигабайтами звучит буквально как «автомобиль с багажником на 500 литров быстрее, экономичнее, комфортнее и лучше в управлении, чем автомобиль с багажником на 350 литров».

Иначе говоря — представляет собой полный абсурд.

Во-первых, производительность видеокарты определяется в первую очередь характеристиками ее ГПУ: количеством исполнительных блоков, архитектурными особенностями, рабочими частотами. Говоря проще — при одинаковом объеме набортной памяти (6 гигабайт), бюджетная GeForce GTX 1660 никогда не будет равна GeForce RTX 2060, стоящей на пару ступеней выше в линейке продуктов.

Но в качестве наглядного примера мы рассмотрим другие карты аналогичных классов:

Встроенный бенчмарк игры Assassin’s Creed: Odyssey запущен в разрешении FullHD с настройками графики, соответствующими штатному профилю «Высокое качество». Конфигурация ПК полностью идентична, за исключением самих видеокарт.

Слева — Radeon RX 5600 XT в исполнении Sapphire с типичными для этой модели 6 гигабайтами набортной памяти.

Справа — Radeon RX 5500 XT в исполнении MSI в версии с 8 гигабайтами набортной памяти.

Частоты видеокарт, в отличие от ЦПУ и оперативной памяти, не приведены к общему знаменателю, но в данном случае этого и не требуется — разница и без того очевидна.

В первом случае по итогу тестовой сцены мы получаем 74 кадра по среднему фпс, 62 кадра по минимальному и просадки до 59 кадров в 1% редких событиий. Во втором — 60, 50 и 48 кадров соответственно.

Так какая карта оказывается быстрее — с 6 или с 8 гигабайтами памяти на борту?

Во-вторых, как уже говорилось выше, память видеокарты — это хранилище данных. А размеры любого хранилища рассчитываются исходя из объема содержимого, которое в него планируется поместить. В случае видеокарты — исходя из объема памяти, который реально задействуют игры. А требования игр — отнюдь не константа, они находятся в прямой зависимости от разрешения экрана и настроек графики. Говоря проще — одна и та же игра на высоких и на средних настройках будет обладать совершенно разными аппетитами.

Рассмотрим следующий пример:

Red Dead Redemption 2, одна из самых требовательных игр последних лет. Здесь используется одна и та же видеокарта — Radeon RX 5500 XT 8gb в исполнении MSI.

Слева используются высокие настройки графики, справа — средние. Разрешение в обоих случаях — FullHD.

Мониторинг позволяет увидеть, что на высоких настройках используется до 6900 мегабайт набортной памяти, так что 8 гигабайт, чтобы поиграть в RDR 2 на высоких, — вполне реальная необходимость. На средних же потребление памяти снижается до 5500 мегабайт — так что карт с 6 гигабайтами памяти на борту для этих настроек тоже хватит. Однако есть одно большое «НО».

C RX 5500 XT, пусть у него и есть необходимые 8 гигабайт памяти, на высоких настройках мы получаем 45 кадров по среднему фпс, 38 — по минимальному и просадки до 36 кадров в 1%.

Бесспорно, многие назовут этот режим играбельным, но, если подходить к вопросу объективно — для по-настоящему комфортного геймплея настройки следует понижать.

На средних же настройках с тем же RX 5500 XT мы получаем 61, 52 и 49 кадров соответственно. Эти показатели как раз и можно назвать комфортными.

Вывод из примеров выше будет следующим:

Объем памяти — важный параметр, но учитывать его необходимо не в отдельности, а только и исключительно в комплексе всех прочих характеристик видеокарты.

Да, в реалиях сегодняшнего дня, даже если вы выбираете видеокарту для игр в самом ходовом разрешении FullHD, следует ориентироваться на карты с объемом памяти в 6 и 8 гигабайт, НО — только в том случае, если выбранная вами карта способна обеспечить комфортный фпс в интересующей вас игре на тех настройках, где эти 6 или 8 гигабайт реально потребуются.

Если же вас интересуют сетевые игры со сравнительно простой графикой, если вы планируете играть в игры не последних лет выпуска, либо если выбирается очень бюджетное решение, способное тянуть тяжелые новинки только на средневысоких настройках — нет смысла гнаться за большим объемом памяти. Во всех этих случаях либо реальное потребление памяти в игре будет сравнительно низким, либо производительность упрется в возможности ГПУ, а не памяти карты.

Так ли важны характеристики разрядности шины памяти или частоты в отдельности?

Этот и последующий пример можно охарактеризовать так же, как и вопрос с объемом памяти видеокарты. А именно — как стремление не рассматривать характеристики продукта не в комплексе, а максимально упростить их, сведя лишь к одному параметру.

Тезисы, разумеется, здесь звучат максимально похоже: «как можно выпускать в 2020 году обрезок со 128-битной шиной?», «да тут всего 192 бита, а еще в прошлом поколении было 256 — я лучше возьму старую карту, она явно быстрее!» и так далее.

Во-первых, помимо ширины шины памяти, есть такие понятия как рабочие частоты и тип памяти. Итоговую пропускную способность подсистемы памяти эти характеристики формируют не по отдельности, а в комплексе. И современные чипы GDDR6 даже на 128-битной шине могут обеспечить те же, или близкие значения к показателям GDDR5 на 256-битной шине.

224 гигабита в секунду против 256 — совсем не та разница, которую следовало бы ожидать, говоря о вдвое «снизившейся» ширине шины памяти.

Однако, во-вторых, сводя все к одному параметру, пусть даже он является комплексным, мы совершаем ровно ту же ошибку, что и рядовые покупатели. Пропускная способность интерфейса описывает лишь максимальный объем данных, который теоретически можно передать за единицу времени.

Ключевое слово здесь — теоретически. На практике же значение имеет архитектура ГПУ и предполагаемые ей алгоритмы сжатия данных.

Рассмотрим очередной практический пример:

Metro: Exodus, встроенный бенчмарк. Разрешение — FullHD, настройки графики — высокие, тесселяция включена, технологии Hairworks и Advanced PhysX — выключены.

Слева — Radeon RX Vega 56, использующий скоростную память типа HBM2 на 2048-битной шине. Справа –GeForce RTX 2060, с типичной для нее GDDR6 на 192-битной шине.

Казалось бы, при таких вводных данных разница в пользу первого решения должна быть очевидной, но на самом деле с Vega56 по итогу теста мы получаем 67 кадров по среднему фпс и 35 — по минимальному, а с RTX 2060 — 66 и 35 кадров соответственно.

Видеокарта — это крайне сложное и технологичное устройство, буквально «компьютер в компьютере», оснащенный собственным процессором, собственным объемом памяти и интерфейсами для передачи данных. И, как у любого компьютера, у видеокарты есть своя архитектура и свой софт, использующий ее преимущества. Поэтому любой параметр, касающийся характеристик видеокарты, нельзя рассматривать в отдельности, а уж тем более — делать какие-то выводы, основываясь исключительно на одном этом параметре.

Впрочем, не совсем так.

Есть один параметр, который действительно может определять и описывать абсолютно все, и согласно которому можно расставлять видеокарты по умозрительной лестнице предпочтений. И это, как легко догадаться — производительность карты в реальных играх.

Корректно ли сопоставлять количество функциональных блоков чипа при сравнении видеокарт разных поколений и от разных производителей?

Характеристики графического процессора, как и центрального процессора компьютера, определяются в первую очередь его частотой и количеством исполнительных блоков — т.е. универсальных шейдерных процессоров, текстурных блоков и блоков растровых операций.

И, как в случае центральных процессоров 6 ядер на частоте в 4000 МГц будут быстрее 4-х ядер на 3400 МГц, так и в случае ГПУ — чем выше частота и больше блоков, тем выше производительность. Однако, тут тоже есть свое большое «НО».

Как и ЦПУ, графические ядра видеокарт можно сравнивать «по цифрам» только в рамках одного поколения и одной архитектуры. Например, Radeon RX 580 с его 2304 процессорами, 144 TMU и 32 блоками ROP будет всегда быстрее RadeonRX 570, характеристики которого можно записать по формуле 2048/128/32.

Но вот когда заходит речь о картах разных поколений или разных производителей — стоит всегда иметь ввиду, что первостепенное значение имеет архитектура, а не частота или количество блоков. Так, карта нового поколения может иметь 2300 универсальных процессоров, а карта предыдущего поколения — все 3600, но в реальных играх полуторакратной разницы вы не увидите:

World of Tanks — правда, уже довольно старой на сегодня версии 1.5.1.3, актуальной на момент проведения тестов. FullHD, настройки графики — ультра.

Слева — Radeon RX 5700, располагающий 2304 универсальными процессорами, 144 текстурными блоками и 64 блоками ROP.

Справа — Radeon RX Vega 56, его прямой предшественник. 3584, 224 и 64 блока соответственно.

Разумеется, частота ГПУ у новинки немного выше, но 240–250 МГц не могли бы обеспечить столь заметный отрыв в производительности при такой разнице в количестве исполнительных блоков. А вот новая архитектура — еще как может!

Оценивать по количественным параметрам и сравнивать между собой можно только видеокарты одного поколения. Если же говорить о картах на принципиально разной архитектуре — можно прийти к условной ситуации, в которой есть некий чип с 1000 универсальных процессоров и его более старый аналог, у которого их 1500.

Казалось бы, второй вариант будет гарантированно быстрее, но вот незадача: 1500 процессоров на старой архитектуре могут выполнять лишь 2 инструкции за каждый такт, а каждый из 1000 новых процессоров — все 4 инструкции.

Пример, разумеется, полностью умозрительный, и аллюзий на реальные графические чипы не предполагающий. Но суть он передает верно.

Как не ошибиться при расчете питания?

Как и любые другие комплектующие, для своей работы видеокарты требуют определенное количество электроэнергии. Соответственно, встает вопрос о том, с помощью чего запитать видеокарту, планируемую к покупке. И в этом случае могут иметь место две крайности:

В обоих этих случаях пользователь оказывается в проигрыше. Поэтому, чтобы не потратить лишних денег и не получить заведомо нестабильную систему, нужно обязательно помнить следующее:

— Блок питания выбирается не «под видеокарту», а под всю систему в целом.

Видеокарта — это только один из составляющих элементов. Помимо нее, в системном блоке также проживают центральный процессор, жесткие диски, оперативная память, материнская плата и, возможно, какие-то платы расширения вроде звуковой карты. Все они в работе также потребляют какое-то количество ватт, и их также нужно учитывать при выборе блока питания.

— Указанная на вашем блоке мощность не обязательно есть в нем фактически.

Качество блоков питания — довольно скользкая тема, и касаться ее в рамках данной статьи мы не будем. Но все же — напомним, что условный блок на 500 ватт, выпущенный в 2010 году и активно эксплуатировавшийся до сегодняшних дней, и современный блок на те же 500 ватт, в реальных замерах выдадут совершено разную мощность. Поэтому, при расчетах совместимости оперировать нужно не цифрами с этикетки, а реальными моделями блоков питания и их фактическим состоянием.

— Фактическое энергопотребление видеокарты и рекомендуемая мощность блока питания — разные вещи.

В характеристиках видеокарт. Указанных на сайтах производителей и в карточках магазинов, можно обнаружить такой параметр, как «рекомендуемая мощность БП». Некоторые часто путают ее с энергопотреблением видеокарты, что и порождает «авторитетные советы» приобретать блоки мощностью 800 ватт к бюджетным видеокартам вроде GTX 1650 — GTX 1660 — RX 5500 XT.

На самом деле, производители видеокарт как раз прекрасно знают предыдущие два тезиса. И рекомендуемая ими мощность — это как раз мощность для ВСЕЙ системы с установленной в нее видеокартой. Более того — мощность эта намеренно завышена, поскольку тем самым производитель защищает себя от претензий со стороны владельцев низкокачественных БП.

Так как определить реальное энергопотребление интересующей вас видеокарты?

Проще всего — прочесть обзор на нее от авторитетного источника. Да, нередко в обзорах указывается энергопотребление всей системы, а не отдельно видеокарты — но так получается даже более наглядно. Ведь, если тестовая система на условном Core i9-9900K в разгоне показывает пиковое энергопотребление на уровне 580 ватт, то ваш компьютер с опять же, условным Core i5-9400F есть будет очевидно меньше.

Впрочем, если в вас вдруг проснется азарт исследователя, можно пойти и более сложным путем.

Одной из основных характеристик современных видеокарт является лимит энергопотребления. Это программное ограничение (аппаратным может являться, разве что, конфигурация разъемов дополнительного питания), по достижении которого видеокарта начинает сбрасывать частоты и понижать напряжения, чтобы остаться в обозначенных пределах.

К примеру, если видеокарта имеет лимит на 130 ватт, то без разгона и ручного поднятия лимита больше есть она не будет — как бы различные «интернет-знатоки» ни советовали вам покупать для нее блоки мощностью 800 ватт минимум.

А поскольку ограничение это программное — узнать его можно напрямую из биос видеокарты. Для этого нужно либо скачать файл и открыть его диагностической утилитой, либо обратиться, например, к базе данных портала Techpowerup.

Слева — отчет утилиты MorePowerTool о лимитах видеокарты Sapphire Radeon RX 5600 XT Pulse. Лимит энергопотребления для ГПУ составляет 160 ватт. Остальные элементы в данном случае не учитываются, однако их потребление существенно ниже чем у ГПУ, для простоты можно округлить до 30–40 ватт.

Справа — информация о видеокарте Gigabyte GeForce RTX 2060 Windforce OC из базы данных Techpowerup. Здесь уже приводится общий лимит энергопотребления, и он составляет 200 ватт.

Разумеется, лимит энергопотребления — это именно пиковое значение, в реальных задачах видеокарта не всегда будет потреблять максимальное количество электроэнергии, но при расчетах мощности БП следует учитывать именно возможный максимум.

И, конечно же, надо помнить, что при разгоне видеокарты лимит энергопотребления вам придется повышать — а, следовательно, нужно закладывать некоторый запас сверх штатного значения. Опять же, здесь поможет изучение характеристик биос карты — так, на примере выше видно, что для конкретно этой версии RTX 2060 штатными средствами лимит можно поднять лишь на 18%.

При расчетах мощности блока питания для вашей системы следует учитывать всего два фактора: реальное энергопотребление ваших комплектующих и не менее реальные характеристики вашего БП. И с первым, и со вторым поможет вдумчивое изучение обзоров.

В крайнем случае — можно просто сравнить энергопотребление видеокарты, которую вы планируете приобрести, с той, которая стоит в вашем системном блоке сейчас. Хотя современные микросхемы и более сложны, их аппетиты вполне могут оказаться ниже, чем у предшественников.

Важно ли подбирать видеокарту под конкретный процессор?

Сегодня вопросы вроде «а подойдет ли эта видеокарта к моему процессору?» по своему количеству и частоте задавания уже уверенно обходят вопросы совместимости с блоками питания. Можно предположить, что здесь действительно есть какие-то тонкости, однако на самом деле это не так.

Если вопрос касается именно совместимости системы с видеокартой — то модель и семейство установленного процессора ее не определяют. Более того: как правило, если видеокарта использует интерфейс PCI-e и поддерживается в установленной на компьютере ОС — это все, что от нее требуется.

Иначе говоря, если вы собираете ПК на новой платформе, но бюджет не позволяет сразу приобрести видеокарту актуального поколения — можно использовать карту, оставшуюся от предыдущей системы, или бюджетное решение старого поколения, купленное на вторичном рынке.

И обратное тоже верно: в компьютеры, собранные на не самых новых платформах, можно устанавливать видеокарты актуальных поколений, если вам не хватает производительности графической части, или бюджет позволяет заменить только видеокарту.

Встроенный бенчмарк игры Assassin’s Creed: Odyssey утверждает, что тестовая система объединяет процессор Intel Corei7-4930K, выпущенный в 2013 году для уже давно устаревшей платформы LGA 2011, и видеокарту GeForce RTX 2080 Ti, выпущенную в конце 2018 года, и актуальную до сих пор.

Причем, разумеется, пример выше — далеко не единственный. При желании в Интернете можно найти множество сборок даже на более старых процессорах — к примеру, Core i5/i7 Sandy Bridge и FX Piledriver, объединенных с современными видеокартами. И не только в виде статичных картинок, но и видеороликов, посвященных сборке и тестированию получившихся систем.

Безусловно, бывают случаи индивидуальной несовместимости, когда видеокарта напрочь отказывается инициализироваться и работать, хотя сама она гарантированно исправна. Но, во-первых, в современных реалиях это большая редкость, а во-вторых, вопросы в данном случае следует адресовать к материнской плате, а не к процессору.

Однако речь может идти не просто о совместимости и возможности эксплуатировать систему с новой видеокартой, но и об итоговой производительности получившегося компьютера в играх. И здесь все уже отнюдь не так просто.

Мифы о «раскрывашках»

«Раскрывашки», наиболее активно нервировавшие интернет-сообщество в период с 2014 по 2018 год, сегодня уже являются в большей степени забавным мемом и поводом для шуток, нежели серьезной проблемой. Однако и сейчас изредка проскакивают вопросы вроде «а раскроИт ли?», в которых потенциальные владельцы новых видеокарт желают знать, насколько быстрой окажется их система после апгрейда.

Согласно популярному заблуждению, к новым и быстрым видеокартам обязательно приобретать процессоры новых поколений. Причем чем выше будет индекс модели — тем лучше для производительности. Хотя реальные системные требования игр, как и соотношение производительности уже имеющегося у пользователя процессора с рекомендуемой ему моделью значения здесь никакого не имеют.

Если же пользователь не желает приобретать новый процессор (разумеется, вместе с полагающейся к нему материнской платой и в некоторых случаях — оперативной памятью), ему заявляется, что и в апгрейде видеокарты нет никакого смысла, ведь работать она будет на уровне младших моделей той же линейки, а то — и вовсе так же, как и старая видеокарта.

Разумеется, все это — крайности, доведенные до абсурда. И ключевая задача любой «раскрывашки» — не помочь, а именно убедить пользователя потратить деньги на новое железо помимо видеокарты. Чего ему, возможно, вовсе и не надо делать.

В реальности, конечно, процессор оказывает существенное влияние на производительность системы. Но, во-первых, не он один, а во-вторых — влияние это не во всех играх одинаково, и уж точно не определяется индексом модели процессора.

Рассмотрим несколько примеров.

Total War: Three Kingdoms. Игра, довольно требовательная к ресурсам центрального процессора и к тому же — использующая преимущества многопотока.

Слева — Intel Core i9-9900KF. Справа — Intel Core i7-9700KF. Оба процессора разогнаны до 5000 МГц, частота кольцевой шины поднята до 4700 МГц, видеокарта RTX 2080 Ti работает в штатном для нее режиме, все прочие условия идентичны.

При этом, в случае с Core i7-9700KF фпс в бенчмарке оказывается… выше!

Да, это исключительно частный случай, связанный с тем, что технология Hyper Threading, отличающая Core i9 от Core i7, в играх далеко не всегда работает корректно, и производительность старшей (. ) модели ЦПУ при прочих одинаковых условиях оказывается ниже, чем у младшей.

Встроенный бенчмарк игры WarThunder, являющейся уже диаметрально противоположным примером. Движок игры по сей день активно использует не более 2-х ядер.

Слева — снова Core i9-9900KF, но на сей раз — в номинальном для него режиме. 4700 МГц по всем ядрам за счет технологии MCE, 4300 МГц на кольцевой шине. Справа — уже Core i5-9600KF, разогнанный ровно до тех же параметров. Все прочие характеристики системы идентичны, в качестве видеокарты опять используется RTX 2080 Ti.

Разница в фпс, опять же, в комментариях не нуждается. В данном случае Core i9 в принципе не может иметь никаких преимуществ над Core i5 — игра попросту не использует «лишние» ядра. А технология Hyper Threading здесь опять ведет себя не лучшим образом, что и позволяет Core i5-9600KF выдавать немного больше кадров в секунду.

И это далеко не единственные примеры, категорически не вписывающиеся в картину мира, предлагаемую раскрывашками.

В реальности у каждой игры свои требования к характеристикам центрального процессора. Так, где-то используется максимально доступное количество ядер — и, например, старые процессоры под ту же платформу LGA 2011 могут не только эффективно справляться с игрой, выпущенной на 7 лет позже них самих, но и обеспечивать более комфортный геймплей, чем современные модели под LGA 1151_v2.

Где-то — наоборот, количество ядер не имеет значения, важна только тактовая частота и производительность в однопоточной нагрузке. Какие-то игры в силу особенностей движка в принципе мало зависимы от процессора и более требовательны к видеокарте. Да и сама «зависимость» от характеристик процессора в одной и той же игре может меняться со сменой разрешения экрана и настроек графики: чем они выше — тем выше влияние видеокарты, и менее заметна разница между более и менее быстрыми ЦПУ.

Раскрывашки же эти факты игнорируют и сводят все к одному простому тезису: «более дорогой и новый процессор — лучше». Но для кого именно лучше — обычно умалчивают.

Заключение

Конечно, в данной статье мы рассмотрели лишь часть распространенных ошибок, совершаемых при выборе видеокарт. Если начинать рассматривать отдельные семейства — да что там, даже отдельные ценовые сегменты! — то легенд и мифов можно будет обнаружить великое множество.

Но и эти, и любые другие мифы рождаются там, где нет четкого знания и подтвержденной информации. Выдумка, изложенная максимально просто и понятно, всегда будет более притягательна, чем факты, которые нужно изучать, анализировать и сопоставлять. Однако опираться на выдумки никогда не стоит.

Если вы хотите получить товар, максимально отбивающий свою цену — стоит сперва потрудиться и изучить сведения о нем сразу в нескольких авторитетных источниках, а не следовать первой попавшейся на глаза рекомендации.